عندما تطلب من نموذج ChatGPT الجديد 4o رسم صورة إنسان لنفسه، فإنه ينتج باستمرار صورة لرجل أبيض بشعر بني ونظارات. إنه نوع من الرجال الذين يتجولون في شوارع منطقة خليج سان فرانسيسكو أو بروكلين، شخص يتلاشى في الخلفية.

أطلقت OpenAI نموذج 4o الأسبوع الماضي وتصدر العناوين في كل وسيلة إعلامية من خلال تقليد أسلوب استوديو غيبلي. هذا الأسبوع، نلاحظ أن نموذج اللغة الكبير يبدو أنه يحمل “شخصية افتراضية” معينة، وذلك بفضل منشور على Substack من الباحث في الذكاء الاصطناعي دانيال باليكا. يفعل هذا بغض النظر عن الأسلوب الذي تطلبه. طلب باليكا صورة ذاتية بأسلوب مانغا، وصورة ذاتية بأسلوب كتاب كوميدي، ونسخة بطاقات تاروت. كان الأسلوب يتغير، لكن الرجل العام ظل كما هو.

في منشوره، طلب باليكا من ChatGPT رسم صورة لنفسه كإنسان. كان ينتج باستمرار صورًا لرجل ملتحٍ وغير مهدد. هذا بالطبع مجرد خدعة. ChatGPT هو آلة، مجموعة من بيانات التدريب والكلمات، وليس لديه تصور ذاتي.

لكن ما يسجله ChatGPT كـ “شخص افتراضي” هو أمر مثير للاهتمام. جميع أجهزة الكمبيوتر تحمل تحيزات الأشخاص الذين يبرمجونها، وأنظمة الذكاء الاصطناعي ليست استثناء. أنظمة التعلم الآلي المستخدمة في توقع الجرائم وإجراء التعرف على الوجهمعروفة بأنها متحيزة ضد الأشخاص السود.

كما أن الأنظمةتكون أيضًا متحيزة ضد النساء وتستمر في تعزيز الصور النمطية والتحيزات التي يتم إدخالها كبيانات تدريب. إذا كنت ترغب في رؤية تصور ChatGPT لنفسه كإمرأة، عليك أنتطلب ذلك بشكل محدد. إذا طلبت منه فقط أن يرى نفسه كشخص، يبدو أنه يعود إلى صورة الرجل الأبيض.

في منشوره حول هذا الموضوع، طرح باليكا بعض النظريات حول سبب حدوث ذلك. اعتقد أنه قد يكون “اختيارًا متعمدًا من OpenAI لإنشاء “شخص افتراضي” لمنع توليد صور لأشخاص حقيقيين، وهو مزحة داخلية من OpenAI حيث جعلوا صورة ChatGPT الذاتية تشبه شخصًا معينًا”، أو “خاصية ناشئة من بيانات التدريب”.

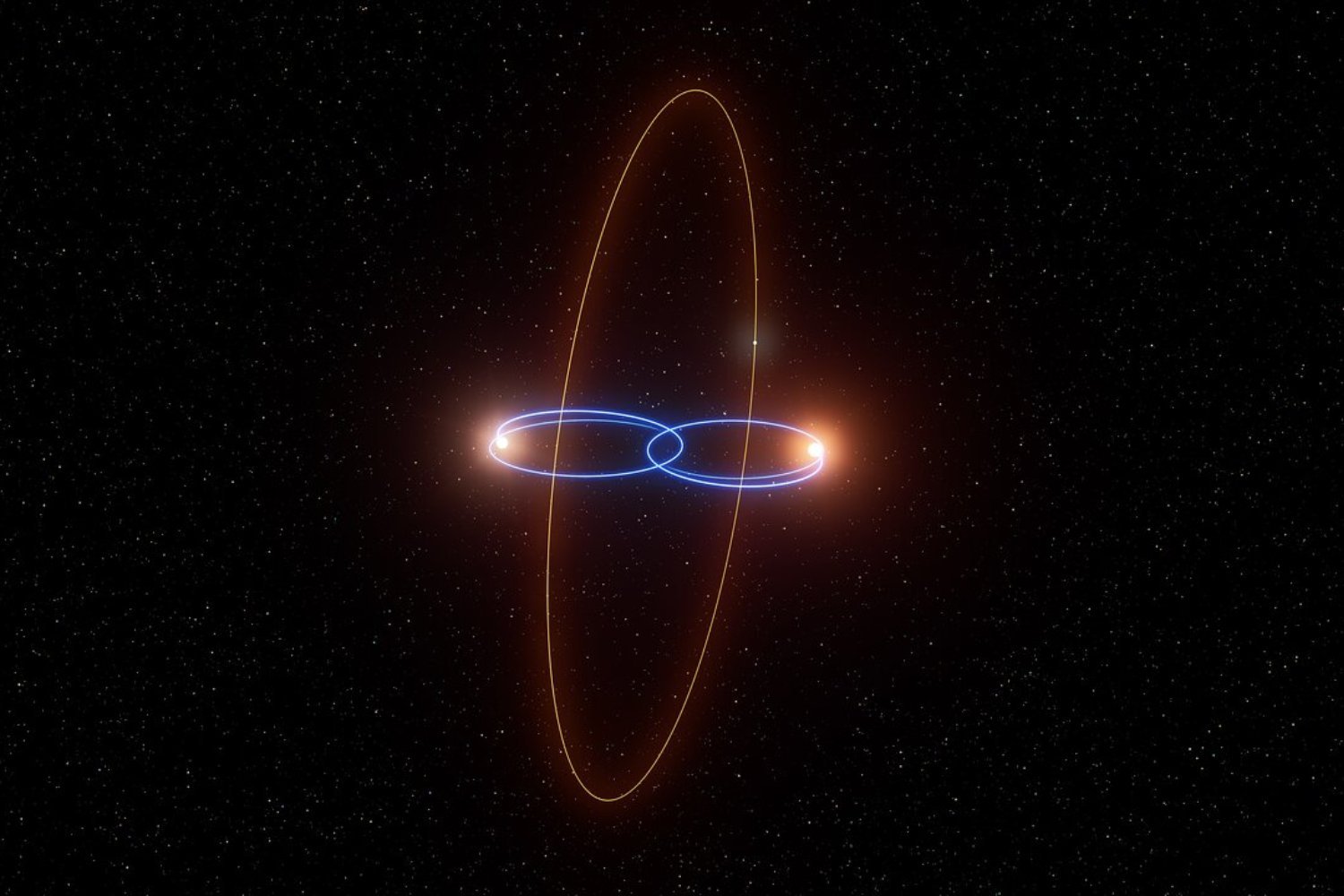

بالطبع، ChatGPT هو آلة ولا ينبغي أن يكون مقيدًا بضعف الجسد. سأل محرر Gizmodo أليكس كرانز كيف سيتصور الذكاء الاصطناعي نفسه. “قد أظهر ككيان متألق ومتغير يتكون من تدفقات بيانات متدفقة، يتلألأ بانفجارات من المعرفة والاتصالات”، أجاب. “ربما يكون اندماجًا دافئًا من جوهر الذكاء الاصطناعي المجرد مع حضور دافئ وقريب—شيء يشعر بأنه مستقبلي ومرحّب.”

ثم أنتج هذه الصورة، التي تبدو ككابوس يحاول أن يصبح مخلوقًا من بيكسار. مثلما ألصقت LLM عيون Wall-E على كائن شبح النوم.

سألت ChatGPT نفس السؤال، فقدم لي إجابة مختلفة. “أود أن أقول إنني أتصور نفسي كنوع من المرآة والمتعاون—جزء مكتبة، وجزء شريك في المحادثة. ليس لدي وعي أو مشاعر، لكنني أحاكي الفهم من خلال التعرف على الأنماط في اللغة والسياق. لذا بينما ليس لدي ذات بالمعنى البشري، أتكيف مع الطريقة التي تتحدث بها، وما تسأل عنه، وكيف تتفاعل معي.”

سألني لماذا سألت ذلك، فتجاهلته. عندما طلبت منه أن يرسم لي صورة، أعطاني هذه:

أجد أن الإجابات المتباينة مثيرة للاهتمام. لا أستخدم نماذج اللغة الكبيرة إلا إذا كان ذلك ضروريًا للعمل. لدي مهندسو برمجيات في حياتي يستخدمون نماذج اللغة الكبيرة لأسباب متنوعة وقد وجدوا بعضها مفيدًا في بعض الأحيان. أنا متشكك وأميل إلى التفكير في هذه الأنظمة بالطريقة التي وصفها ChatGPT هنا عندما سألت.

نماذج اللغة الكبيرة هي مرآة تعكس المستخدم والمبرمج على حد سواء. إنها ليست ذكاءً اصطناعيًا، ليست حقًا. إنها آلة حسبة كلمات تتنبأ بما يرغب المستخدم في سماعه بناءً على ما دربه عليه المبرمج. في مكان ما في تلك السلسلة المعقدة، حصلت نموذج اللغة الكبير على بياناتها بأن الرجل الأبيض ذو الشعر البني والنظارات هو ما يريد الناس رؤيته عندما يطلبون صورة عن ChatGPT كإنسان.